Mi történik, ha kétszer írod be ugyanazt a promptot?

Az utóbbi időszakban több gyakorlati megfigyelés és szakmai vita is rámutatott arra, hogy a nagy nyelvi modellek (LLM-ek) teljesítményét nagyban befolyásolja, hogy hogyan épül fel a prompt szerkezete. Egy friss kutatás ezt a kérdést nagyon konkrétan, mérhető módon vizsgálja: mi történik, ha ugyanazt a promptot kétszer egymás után adjuk meg a modellnek?

A válasz röviden: több modellen és több feladaton is kimutathatóan javulhat a pontosság, miközben a válasz hossza nem nő, és a válaszidő sem romlik érdemben, az egyik modell teljesítménye például 21%-ról 97%-ra ugrott egy olyan feladaton, ahol csak annyi volt a teendő, hogy egy névlistából meg kell találni a keresett nevet / pozíciót.. A részletek viszont sokkal érdekesebbek.

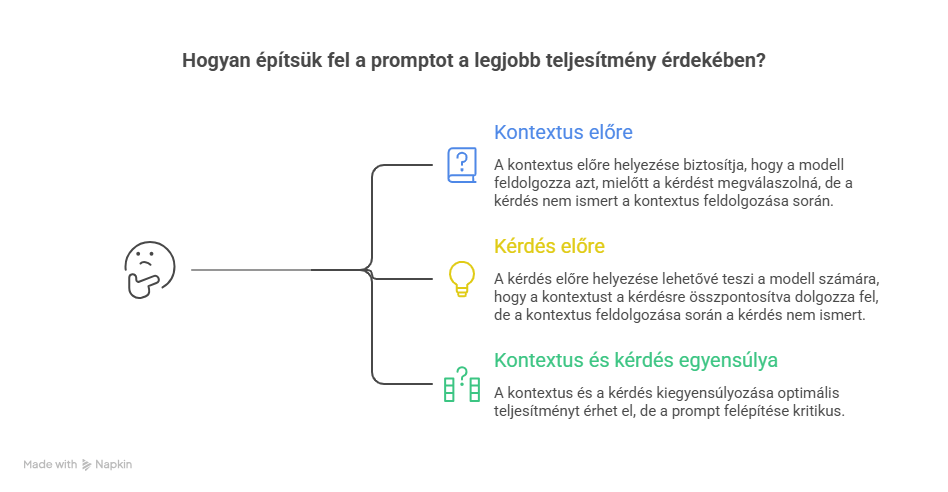

Hogyan dolgozza fel a szöveget egy LLM?

A klasszikus, kauzális nyelvi modellek a bemenetet balról jobbra olvassák, és minden token kizárólag a korábban látott tokenekre tud figyelni, tehát előre nem lát. Ez azt jelenti, hogy amikor egy hosszú prompt elején megadsz egy kontextust, majd a végén teszed fel a kérdést, a modell a kérdés megválaszolásakor már beolvasta a kontextust, ugyanakkor a kontextus feldolgozása során még nem tudta, mi lesz a prompt végén a konkrét kérés.

Ez nem feltétlen hiba, csak architekturális sajátosság: a prompt elején lévő részek más információs helyzetben kerülnek feldolgozásra, mint a prompt végén lévő részek. Emiatt a prompt felépítése (mi kerül előre, mi kerül hátra, hogyan tagolunk) sok feladatnál teljesítménykérdés.

A duplikált prompt módszer lényege

A kutatás egy meglepően egyszerű módszert tesztel:

a teljes promptot kétszer egymás után küldjük el, változatlanul [PROMPT][PROMPT]

A gondolatmenet a következő: a második ismétlésben a modell ismét végigmegy ugyanazon a szövegen, viszont ekkor már mögötte van az első példány minden információja. Így a bemenet egyes részei kvázi kapnak egy második feldolgozási kört, ahol több összefüggést tudnak felvenni a teljes feladatszöveggel.

Fontos hangsúlyozni, hogy ebben az esetben nem történik finomhangolás vagy prompt engineering, pusztán a bemenet ismétlése.

Mit mértek, és milyen eredményeket kaptak?

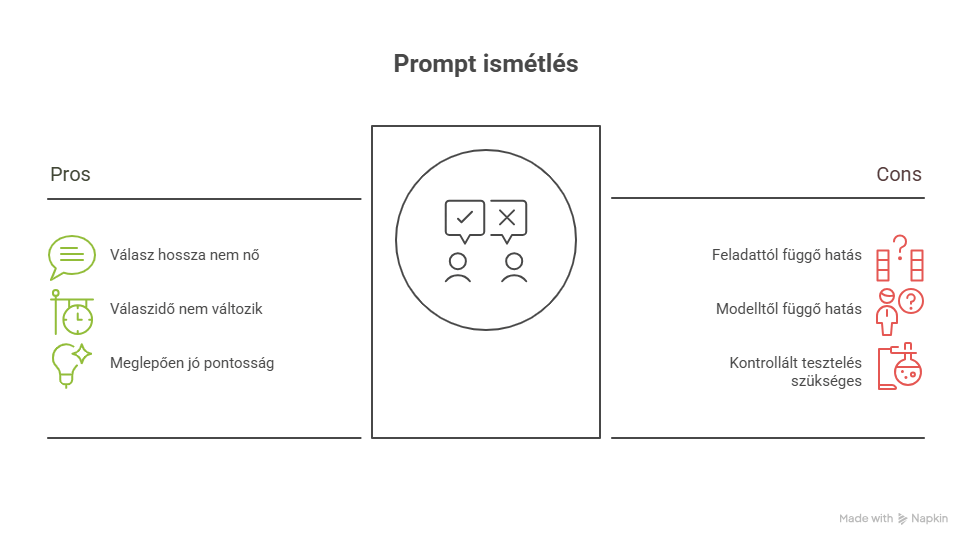

A cikk több modellt és több benchmarkot vizsgál, és összességében azt találja, hogy a prompt ismétlése számos esetben javítja a pontosságot, miközben

- a modell válaszának hossza nem nő,

- és a válaszidő jellemzően nem változik érdemben (különösen akkor, ha a fő költség a generálás, nem a hosszú kimenet).

A tanulmányban szerepel egy különösen szemléletes, célzott feladat is (“NameIndex” jellegű keresési/pozíció-azonosítási feladat), ahol az egyik modell teljesítménye az ismétlés hatására extrém mértékben javult. A szerzők ezt pont azért emelik ki, mert jól mutatja: a módszer hatása feladattípustól és modelltől függően nagyon eltérő lehet.

A gyakorlati tanulság hogy:

- bizonyos promptstruktúráknál és feladatoknál ez a módszer meglepően jól pontosítja a választ a befektetett energiához képest,

- és érdemes kontrolláltan letesztelni a saját use case-eiteken.

Mikor érdemes kipróbálni?

A kutatás logikája alapján különösen ezeknél a feladatoknál lehet releváns:

- hosszabb kontextus + rövid kérés (ahol a kérés a prompt végén van),

- listák, szabályok, opciók alapján történő döntés (klasszifikáció, kiválasztás),

- olyan munkafolyamatok, ahol a cél a rövid, pontos válasz.

És mikor kevésbé? Ha eleve olyan beállításban dolgozol, ahol a modell kifejezetten végiggondolja a problémát, az ismétlés várhatóan kisebb hozzáadott értéket hoz, a tanulmány is arra utal, hogy a hatás mértéke erősen függ a modell viselkedésétől és a feladat jellegétől.

Javaslat: kísérletezzetek intézményes módon

Ha a csapatotoknál a generatív AI már üzleti folyamatokban támogat döntéseket, érdemes ezt mérhetően kipróbálni. Például:

- Válassz ki 20–50 tipikus feladatot (ugyanaz a kérdéskör, hasonló promptok).

- Futtasd le a megszokott promptoddal.

- Futtasd le duplikált prompttal (minden más változatlan).

- Mérd le: pontosság, hibaarány, szükséges utómunka, válaszidő.

Ez a fajta tesztelés tipikusan 1–2 órán belül ad olyan eredményt, ami alapján eldönthető, hogy nálatok ez csak érdekesség, vagy ténylegesen beépíthető módszer.

Ha ezt a szemléletet rendszerszinten szeretnétek felépíteni

A duplikált prompt módszer jó példa arra, hogy a generatív AI használatában a promptolás nem kreatív szövegírás, hanem strukturált, mérhető módszertan. Pont ezért építettük fel a Generatív AI és Prompt Engineering képzésünket úgy, hogy ne csak eszközhasználatot adjon, hanem:

- Nyelvi modellek és más generatív AI modellek működésének megértését, hogy pontosan lásd, mire képesek ezek az eszközök és hogyan hozhatod ki belőlük a maximumot (pl: ChatGPT, Gemini, Copilot, Perplexity vagy Claude)

- Prompt engineering alapjainak megismerését nyelvi és más generatív AI modellek hatékony használatához.

- Promptoláson túlmutató haladó módszereket a generatív AI lehetőségeinek kihasználásához.

Nézd meg a tematikát itt: https://cubixedu.com/generativ-mesterseges-intelligencia-es-prompt-engineering-kepzes?utm_source=blog&utm_medium=cikk