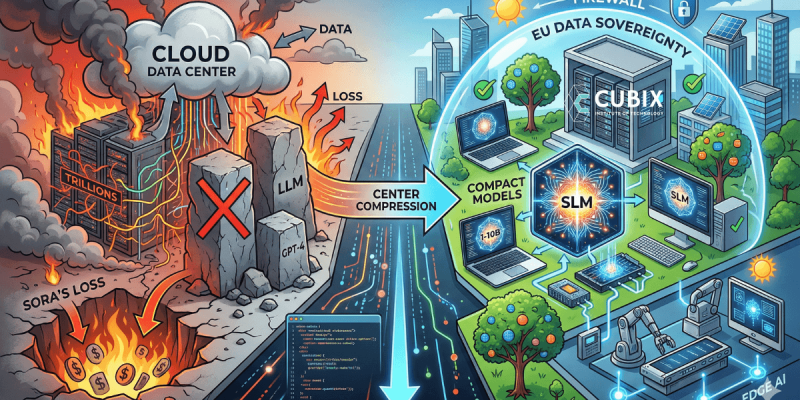

Tudtad, hogy a vállalati célú mesterséges intelligencia-megoldások több mint fele 2026-ra már nem a távoli felhőben, hanem a cégek saját eszközein vagy belső szerverein futó kompakt nyelvi modelleken (SLM) alapul? Míg az elmúlt években a figyelem középpontjában a GPT-4-hez hasonló, több ezermilliárd paraméterrel rendelkező nagy nyelvi modellek (LLM) álltak, a technológiai szektor mára felismerte: a fenntartható fejlődés és a valós üzleti érték elérése érdekében a célzott, helyi alkalmazásokra kell helyezni a hangsúlyt.

Ez a váltás alapjaiban írja felül a korábbi szoftverarchitekturális megközelítéseket. Nem csupán egy trendről van szó, hanem egy kényszerű alkalmazkodásról a gazdasági és szabályozási környezethez.

Tanulságok a Sora esetéből: Amikor az innováció nem találkozik a megtérüléssel

A piaci szemléletváltás egyik legmeghatározóbb előjele az OpenAI közelmúltbeli bejelentése volt, amellyel felfüggesztették a Sora videogeneráló szolgáltatását. Az eset rávilágított arra, hogy hiába képes egy technológia látványos eredményekre, ha az üzemeltetése napi egymillió dolláros veszteséget termel. A Sora példája a „brute force” megközelítés, vagyis a hatalmas számítási kapacitás és energia korlátlan felhasználása, gazdasági korlátait jelzi.

A vállalatok számára a tanulság egyértelmű: a jövő nem a mindenre is alkalmas, de fenntarthatatlanul drága óriásmodelleké, hanem a specifikus feladatokra optimalizált, gazdaságosan üzemeltethető rendszereké. Míg egy Sora-szintű vizuális modell futtatása a legtöbb szervezet számára megfizethetetlen, egy helyi infrastruktúrán üzemelő, kompakt modell fix és tervezhető költségek mellett nyújt mérhető üzleti hasznot.

A FinOps szerepe: A token-alapú elszámolás vége?

A 2024-es és 2025-ös időszak tapasztalatai alapján a szervezetek elkezdték számszerűsíteni a felhőszolgáltatások hosszú távú költségeit. A FinOps (pénzügyi műveletek a felhőben) szemléletmód elterjedésével világossá vált, hogy a token-alapú elszámolás – ahol minden egyes bemeneti és kimeneti karakterért fizetni kell – gátolja a skálázódást.

Egy olyan nagyvállalati rendszerben, amely napi több tízezer dokumentumot elemez vagy ügyfélinterakciók ezreit kezeli, a felhőköltségek lineárisan emelkednek a használattal. Ezzel szemben a saját infrastruktúrára telepített kompakt modellek (SLM) esetében a költséggörbe ellaposodik: a kezdeti hardverberuházás és a finomhangolás után az üzemeltetési költség minimálisra csökken. 2026-ban a gazdasági racionalitás azt diktálja, hogy a cégek visszavegyék az irányítást a saját számítási kapacitásuk felett.

Technológiai sűrítés: Hogyan lesz a „kisebb” mégis hatékonyabb?

A kompakt nyelvi modellek sikere mögött komoly mérnöki innováció áll. Az SLM-ek (jellemzően 1–10 milliárd paraméter között) nem véletlenszerűen kisebbek; olyan eljárásokkal készülnek, mint:

- Tudáslepárlás (Knowledge Distillation): Egy hatalmas „tanár” modell (LLM) segít betanítani egy kisebb „diák” modellt, átadva neki a legfontosabb logikai összefüggéseket, de elhagyva a felesleges, általános ismereteket.

- Kvantálás: A modell súlyainak matematikai precizitását csökkentik (például 16 bitről 4 bitre), ami drasztikusan lecsökkenti a memóriaigényt, miközben a specifikus feladatokban a pontosság szinte változatlan marad.

- Célzott tanítás: Míg egy LLM-nek tudnia kell verset írni és kvantumfizikát magyarázni, egy vállalati SLM-et csak jogi dokumentumok elemzésére vagy Java-kód optimalizálására képeznek ki.

Adatbiztonság és digitális szuverenitás 2026-ban

Az Európai Unió AI Act szabályozásának 2026-os teljes körű hatályba lépése szigorú keretek közé szorította a szervezeti adatkezelést. A törvényi megfelelés érdekében a kritikus ágazatokban (bankok, egészségügy, kormányzati szervek) működő vállalatoknak garantálniuk kell, hogy a bizalmas adatok nem hagyják el az ellenőrzött hálózatot.

Ez a szabályozás alapjaiban írja át a hazai vállalkozások életét is. Ahogy azt korábbi szakmai webináriumunkban Dr. Vajda Viktor (AI specialista mesterjogász) és Vadász Gábor (BDO Digital technológiai vezetője) részletesen kifejtették, a törvényi megfelelés egyik sarokköve az AI Literacy (MI-jártasság) lesz.

A jogszabály 4. cikke előírja, hogy a vállalatoknak biztosítaniuk kell munkatársaik számára a megfelelő szintű képzést az általuk használt MI-rendszerekről. Ez nem csupán jogi kötelezettség, hanem a biztonság záloga is: a lokális SLM-ek használatával elkerülhető a Shadow AI jelensége, amikor a kollégák ellenőrizetlenül töltenek fel bizalmas üzleti adatokat publikus felhőalapú modellekbe. A kompakt modellek helyi futtatása megszünteti a harmadik félnek történő adattovábbítás kényszerét. Amennyiben a modell a szervezet saját szervertermében vagy privát felhőjében üzemel, az adatok feldolgozása a belső tűzfalak mögött maradhat. Ez a szuverenitás mára nem csupán jogi elvárás, hanem versenyelőny: az ügyfelek szívesebben bízzák adataikat olyan cégekre, amelyek garantálják, hogy az MI-interakciók nem kerülnek ki egy külső szolgáltatóhoz.

📺 Nézd meg a teljes beszélgetést a szabályozásról és a gyakorlati megvalósításról: AI-megfelelőség és AI-törvény webinárium

Edge AI: Intelligencia a fizikai végpontokon

A számítási kapacitás decentralizációja az Edge AI terjedésében csúcsosodik ki. Az ipari automatizálásban vagy a professzionális szoftvereszközökben a felhőalapú lekérdezések hálózati késleltetése (látenciája) kockázati tényező. A kompakt modellek képesek közvetlenül a fejlesztői munkaállomásokon vagy ipari vezérlőkön futni, így a válaszidő milliszekundumokra csökken, és a rendszerek internetkapcsolat nélkül is zavartalanul működnek.

A szoftvermérnöki karrier új iránya

Ez az elmozdulás a fejlesztők felé is új elvárásokat támaszt. 2026-ban a szakmai érték már nem az API-dokumentációk ismeretében rejlik, hanem az alábbi készségekben:

- Modell-implementáció: Képesség a nyílt forráskódú modellek (pl. Llama, Phi) helyi telepítésére és optimalizálására.

- RAG-architektúrák: Olyan rendszerek tervezése, ahol a kompakt modell biztonságosan fér hozzá a vállalat friss belső adataihoz.

- Erőforrás-menedzsment: A szoftver és a hardver (GPU/NPU) közötti hatékony kapcsolat megteremtése.

A McKinsey 2026-os elemzése alapján azok a szervezetek, amelyek kompakt modellekre alapozták folyamataikat, átlagosan 40%-kal csökkentették az MI-hez kapcsolódó felhőalapú kiadásaikat.

Összegzés: A specializált modellek korszaka

A kompakt nyelvi modellek térnyerése a technológia érettségét jelzi. 2026-ban már nem egyetlen, „mindenre jó” rendszertől várjuk a megoldást, hanem speciális feladatokra szabott, biztonságos és gazdaságosan üzemeltethető modellek hálózatát építjük ki.

A Cubix képzésein ezért fektetünk nagy hangsúlyt arra, hogy hallgatóink ne csak a népszerű felhős szolgáltatások felhasználói legyenek, hanem képessé váljanak a jövő elvárásainak megfelelő, helyben futó és magas biztonsági fokú rendszerek tervezésére és üzemeltetésére is. Aki elsajátítja az SLM-ek implementálásának és finomhangolásának ismereteit, az a következő évek egyik legkeresettebb szakemberévé válhat a munkaerőpiacon.

Kapcsolódó tartalom: 👉 Olvasd el elemzésünket a Sora leállásának hátteréről és a gazdasági korlátokról!

Hivatkozott kutatások és források: