Amit Galilei, egy budapesti csőtörés és egy meglepő kutatás elárulnak arról, miért zseniális néha a mesterséges intelligencia – és miért mond katasztrofális hülyeséget máskor

Oktatói esettanulmány-sorozatunk következő részében Fausztin Asztrik, AI engineer, a BME-KJK és ELTE-TTK oktatója, nálunk AI asszisztens alkalmazások fejlesztése és evaluációja képzésünk mentora köti össze Galileit, a csőtörést és az AI-ba vetett bizalmunkat. Érdemes elolvasni, főleg, mert a szerző öbb mint 7 éve fejleszt MI-megoldásokat, főként autonóm járművek R&D-csapataiban (Bosch). Dolgozott AI-fókuszú “butik” ügynökségeknél (Lain-Consulting, Palindrom). Szakterülete a modellek teljesítménymérése, élesítése és a folyamatos fejlesztés támogatása.

Nemrég csőtörés volt nálunk – egy átalakított lakásban, ami eredetileg nem is hálószoba volt. Néztem a munkásokat, ahogy kibontják a falat, és azon gondolkodtam: ők ezt minden nap csinálják, de minden egyes lakás más. Más a falszerkezet, más a csővezetés, máshol van az elosztó, máshol a tartófal. Amit az egyik szobában megtanultak, az a következőben lehet, hogy semmit sem ér.

Ugyanakkor, ha megkéred a ChatGPT-t, hogy írjon neked egy Python scriptet, ami kiolvassa egy Excel fájl harmadik oszlopát és átlagot számol belőle, valószínűleg elsőre tökéleteset kapsz.

Két feladat. Az egyiknél az AI csődöt mondana, a másiknál jobban teljesít, mint a legtöbb ember. Miért?

Ahhoz, hogy erre a kérdésre valóban jó választ kapj – olyat, amit holnaptól használni tudsz, amikor eldöntöd, mennyire bízol egy AI-outputban –, el kell mesélnem egy 400 éves történetet.

Galilei problémája

Galileo Galilei szeretett volna egy egyszerű kérdésre válaszolni: ha elejtünk valamit, mekkora utat tesz meg T idő alatt? Lejtőn gurított golyókkal kísérletezett, mert a szabadesés túl gyors volt a pontos méréshez.

A mérései tele voltak hibával. De azért kirajzolódott egy mintázat az adatokban. A kérdés: hogyan írjuk le ezt a mintázatot úgy, hogy ne csak a már megfigyelt esetekre legyen igaz, hanem újabb, még nem látott helyzetekre is működjön?

Mert ez az, amitől egy modell hasznos: nem attól, hogy visszamondja, amit már tudunk, hanem hogy olyasmire is választ ad, amit még nem láttunk.

Ez pontosan az a kérdés, amivel minden mesterséges intelligencia küzd. És amitől függ, hogy mikor bízhatsz benne.

Három közelítés, három féle bizalom

Galilei adatain háromféleképpen próbálhatunk rendet tenni.

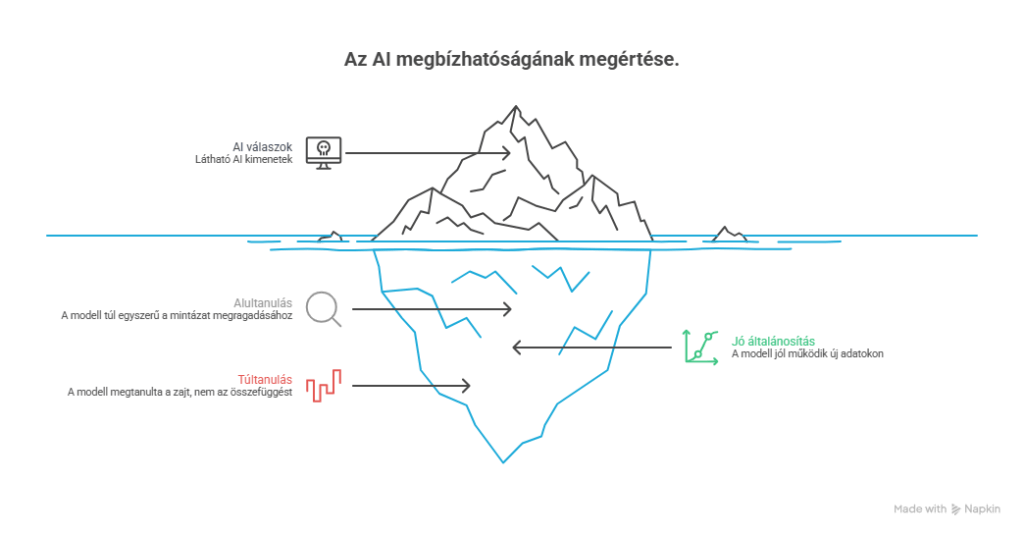

Az egyenes vonal. Húzzunk egy egyenest az adatokon keresztül. Ez egyszerű – és sajnos pontatlan, mert nem képes lekövetni az adatok görbületét. Ezt hívjuk alultanulásnak: a modell túl egyszerű ahhoz, hogy megragadja a mintázatot. Ilyen AI-választ is kapsz néha – felszínes, semmitmondó, nyilvánvalóan leegyszerűsítő. Ilyenkor jogosan nem bízol benne.

A parabola. Ez már sokkal jobban követi a mért pontokat. De ami igazán fontos: ha új méréseket végzünk, amiket a modell sosem látott, azokra is meglepően jól működik. A parabola a mögöttes összefüggést ragadta meg, nem csak a konkrét adatpontokat. Ez a jól általánosító modell – és ez az a helyzet, amikor az AI-ra érdemes hallgatni.

A tökéletes görbe. Használjunk egy annyira bonyolult görbét, hogy minden egyes mérési ponton tökéletesen átmenjen. Nulla hiba a meglévő adatokon! Csakhogy új, ismeretlen esetekre katasztrofálisan teljesít – a görbe vadul kileng és értelmetlen értékeket ad. Mi történt? A modell nem az összefüggést tanulta meg, hanem a zajt – a mérési hibákat, a véletlenszerű ingadozásokat. Betanulta az összes választ anélkül, hogy bármit is „megértett” volna. Ezt hívjuk túltanulásnak. És ez az igazán veszélyes helyzet, mert a modell magabiztosan ad rossz választ – és Te nem biztos, hogy észreveszed.

Ezzel a három forgatókönyvvel – alultanulás, jó általánosítás, túltanulás – a zsebedben van egy keret, amivel megértheted, miért működik néha az AI bámulatos jól, és miért mond máskor nonszenszt.

Ahol az AI csődöt mond: a valóság túl sokféle

Térjünk vissza a csőtöréshez. Miért nem tud egy robot megcsinálni azt, amit a vízszerelő csinál? Nem azért, mert a mozdulatok bonyolultak – hanem mert a variancia a bemenetben brutálisan nagy. Minden lakás más. Minden fal más. Minden csőtörés más. Ahhoz, hogy egy AI erre a feladatra jól általánosítson, gyakorlatilag a fél fizikai világot kellene modellezni.

Ez nem elméleti probléma – éveket dolgoztam a Bosch autonóm járműves csapatában, szóval erről nem könyvekből tudom. A Waymo önvezető taxija ma is csak néhány konkrét amerikai városban működik. Nem véletlenül: ezekben a városokban minden útszakaszt feltérképeztek, a forgalmi szokásokat megtanulták, a helyi körülményekhez alkalmazkodtak. Lényegében ez túltanulás a valóságban: a rendszer remekül működik San Franciscóban, de vidd át Budapestre, és nem fog menni. Univerzális önvezető autó, ami bárhol, bármilyen körülmények között működik? Mai napig nincs.

Ha a Galilei-kereten keresztül nézed: az önvezető taxi olyan, mint a tökéletes görbe – remekül illeszkedik azokra a pontokra, amiket ismer, de amint valami újat lát, katasztrofálisan reagál.

Gyakorlati tanulság: ha az AI-tól olyasmit kérsz, ahol a valós helyzetek nagyon sokfélék lehetnek – egyedi üzleti szituációk, komplex emberi interakciók, speciális szakterületi kérdések, amikből kevés adat áll rendelkezésre –, legyél óvatos. Az AI lehet, hogy magabiztosan válaszol, de a tökéletes görbéhez hasonlóan a konkrét esetekre „emlékezik”, nem a mögöttes logikát érti.

Ahol az AI meglepően jól teljesít: a kód világa

Most jön a másik oldal – és ez az igazán érdekes.

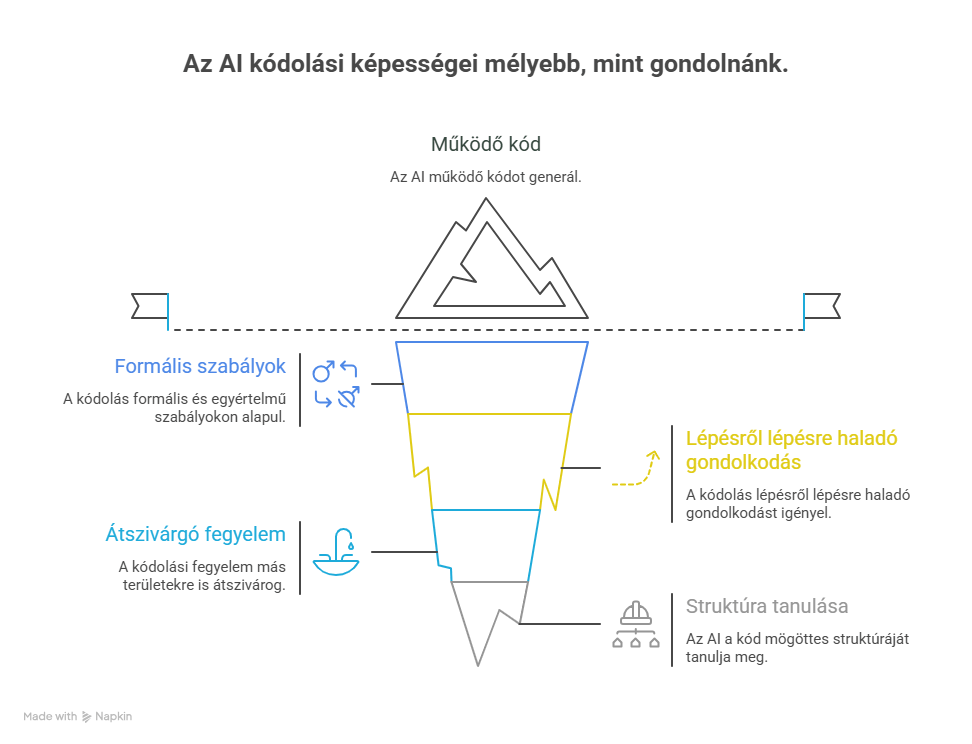

Kérdezd meg a ChatGPT-t vagy a Claude-ot, hogy írjon neked egy Python függvényt, ami rendez egy listát, szűr egy adatbázist, vagy feldolgoz egy CSV fájlt. Nagy valószínűséggel működő kódot kapsz. Nem azért, mert az AI „okos”, hanem mert a programozás világa más, mint a fizikai világ. A szabályok formálisak és egyértelműek. A kód vagy lefut, vagy nem – azonnali visszajelzés van. A logikai struktúra tiszta és lépésről lépésre haladó.

De van itt valami még meglepőbb. Egy 2024-es, az ICLR konferencián publikált kutatás (az egyik legrangosabb MI-konferencia) kimutatta, hogy ha egy nyelvi modellt programkódon tanítanak, az nem csak programozásban lesz jobb – hanem általánosan jobban gondolkodik. Matematikai feladatokban, logikai következtetésben, még szöveges érvelésben is javulást mértek. A kutatók szerint ennek az az oka, hogy a kód természeténél fogva lépésről lépésre haladó gondolkodást igényel: ha egy programban kihagysz egy lépést, nem működik. Ez a fegyelem „átszivárog” más területekre is.

Ez az, amiért a legújabb „reasoning” modellek annyival jobbak a komplex feladatokban, mint az elődeik. Nem egyszerűen több adaton tanultak, hanem a kód logikája megtanította őket gondolkodni: lépéseket tenni, ellenőrizni, visszalépni, ha zsákutcába jutnak.

Ha a Galilei-kereten nézed: a programozás olyan, mint a parabola. A modell nem a konkrét példákat tanulja be, hanem a mögöttes struktúrát – és ezért tud jól általánosítani új, sosem látott feladatokra is.

Gyakorlati tanulság: ha az AI-tól olyasmit kérsz, aminek tiszta logikája van – kódot, adatelemzést, strukturált érvelést, formalizálható feladatokat –, az eredményben lényegesen jobban bízhatsz. Nem vakon és ellenőrzés nélkül, de alapvetően magasabb szintű bizalommal.

A bizalmi spektrum

Ami ebből az egészből kirajzolódik, az nem egy egyszerű igen-nem válasz arra, hogy „bízhatok-e az AI-ban”. Inkább egy spektrum:

Magasabb bizalom – ahol az AI jól általánosít:

- Programozási feladatok, kódgenerálás

- Strukturált adatelemzés, matematikai számítások

- Formalizálható logikai feladatok

- Szövegek összefoglalása, fordítása, átstrukturálása

- Mindenki által ismert, jól dokumentált területek

Alacsonyabb bizalom – ahol az AI hajlamos túltanulásra:

- Egyedi, ritka szituációk, amikből kevés példa létezik

- Speciális szakterületi kérdések (jog, orvoslás, mérnöki tervezés konkrét esetben)

- Aktuális események, friss információk

- Olyan helyzetek, ahol a valós variancia brutálisan nagy – emlékezzünk a csőtörésre és az önvezető taxira

A kettő között óriási a különbség. Aki ezt a spektrumot érti, az nem tiltja be az AI-t és nem bízik benne vakon sem – hanem tudja, mikor melyik a helyes hozzáállás.

Miért számít ez neked?

Ha Te is azok közé tartozol, akik napi szinten használnak AI-t a munkájukban – vagy akik épp most ismerkednek vele –, ez a spektrum a legfontosabb dolog, amit megérthetsz. Nem az a kérdés, hogy melyik a legjobb AI-tool, és nem az, hogy milyen promptot írj be. A kérdés az, hogy adott feladatnál mennyire bízol az eredményben, és miért.

Galilei parabolája azért működött, mert a megfelelő komplexitású modell volt a megfelelő feladathoz. Nem túl egyszerű, nem túl bonyolult – éppen elég ahhoz, hogy a mögöttes összefüggést megragadja.

Ugyanez igaz az AI használatára: a tudatos felhasználó nem az, aki több promptot ismer. Hanem az, aki tudja, mikor kér az AI-tól logikai feladatot (és bízik az eredményben), mikor kér kreatív szöveget (és felülvizsgálja), és mikor ismeri fel, hogy az adott feladat túl sokféle, túl egyedi ahhoz, hogy bármely modell jól általánosítson rá – és ilyenkor emberi szakértelemre van szükség.

Hivatkozott kutatás: „At Which Training Stage Does Code Data Help LLMs Reasoning?” – ICLR 2024